En las primeras semanas de las elecciones a Rector en la Universidad de Murcia celebradas hace unos meses, el tema de moda era la repetida frase de uno de los candidatos sobre la necesidad de situar a nuestra institución en los 500 primeros puestos del mediático Ranking de Shangai (ARWU). Fue tal la pasión que se puso en el tema que creemos se está llegando a producir un cierto efecto rebote sobre esta cuestión, comenzando a generar rechazo hacia los rankings entre los miembros de la comunidad universitaria (muchos de ellos reacios a cualquier tipo de evaluación y/o comparación de su actividad).

En las primeras semanas de las elecciones a Rector en la Universidad de Murcia celebradas hace unos meses, el tema de moda era la repetida frase de uno de los candidatos sobre la necesidad de situar a nuestra institución en los 500 primeros puestos del mediático Ranking de Shangai (ARWU). Fue tal la pasión que se puso en el tema que creemos se está llegando a producir un cierto efecto rebote sobre esta cuestión, comenzando a generar rechazo hacia los rankings entre los miembros de la comunidad universitaria (muchos de ellos reacios a cualquier tipo de evaluación y/o comparación de su actividad).

Suele ser habitual leer de vez en cuando la necesidad de situar a una universidad en los 500 primeros puestos del mediático Ranking de Shangai (ARWU). Es un anhelo de una parte de la comunidad universitaria y además se ha convertido en una herramienta para criticarnos por parte de algunos sectores de la sociedad (produciendo un cierto efecto rebote sobre esta cuestión y comenzando a generar rechazo hacia los rankings entre los miembros de las universidades, algunos de ellos reacios a cualquier tipo de evaluación y/o comparación de su actividad).

Lo cierto es que el citado ranking no entró bien en el mundo universitario porque vino de la mano de uno de los peores ministros que este país ha tenido (hasta hace poco vivió en un exilio dorado de embajador en París). Es por ello que suele citarse normalmente en tono despectivo y no muy bien valorado entre los universitarios, si bien ha conseguido situarse en el centro de todas las conversaciones sobre el tema y no se mencionan habitualmente a otros rankings que sí pretenden reflejar con más cercanía a nuestro mundo el estado la cuestión.

Los compañeros Teodoro Luque-Martínez, Nina Faraoni y Luis Doña-Toledo (profesores de mi segunda alma mater, la Universidad de Granada), acaban de publicar el artículo «Meta-ranking de universidades. Posicionamiento de las universidades españolas» en la Revista Española de Documentación Científica. En este trabajo los autores proponen la elaboración de un meta-ranking que recoge a las 14 universidades españolas que aparecen en al menos cuatro de los cinco rankings globales considerados de reconocida notoriedad internacional (considerando tanto datos bibliométricos como otros aspectos y otras formas de recabar datos a partir de encuestas) y en el que recogen datos de cuatro rankings más (Shangai aparte). Las universidades españolas alcanzan mejores posiciones en los primeros que en los segundos poniéndose de relieve una debilidad mayor en la internacionalización, la reputación o el ratio estudiante-profesor que en los indicadores de investigación. Representan una loable excepción las universidades que destacan en las dos dimensiones. A la vista de estas conclusiones resulta evidente la necesidad de profundizar en una mayor internacionalización, en mejorar la reputación y mejorar la visibilidad internacional de la universidad española.

Los rankings utilizados con fuente en esta investigación son:

- University Ranking by Academic Performance (URAP): http://www.urapcenter.org

- Academic Ranking of World Universities (ARWU); http://www.shanghairanking.com

- National Taiwan University (NTU): http://nturanking.lis.ntu.edu.tw/

- Times Higher Education (THE): https://www.timeshighereducation.com/world-university-rankings

- Quacquarelli Symonds-QS ranking (QS): http://www.topuniversities.com/university-rankings

Los tres primeros utilizan básicamente indicadores bibliométricos especialmente referidos a investigación, mientras que los otros dos (THE y QS) además de algún indicador de esta naturaleza (principalmente citas), también utilizan otros ( internacionalización, reputación, ratio estudiantes por profesor o ingresos por investigación, por ejemplo) y alguno de ellos se obtiene mediante encuestas, como los referidos a la reputación, ya sea académica o de investigación. Estos rankings están entre los más conocidos y gozan de gran notoriedad en la comunidad universitaria internacional, se publican desde hace años y sus puntuaciones son accesibles en sus páginas web. Cada uno recoge datos con matices diferentes, por ello es interesante condensarlos para llegar a generar un meta-ranking. Y una vez elaborado, aplicarlo a las universidades españolas, representándolas y consiguiendo el posicionamiento de las diferentes universidades en dicho meta-ranking.

Las universidades españolas que han sido analizadas en este estudio son las siguientes: Barcelona, Autónomas de Madrid y de Barcelona, Pompeu Fabra, Complutense, Valencia, Granada, Politécnicas de Cataluña y de Valencia, Santiago, País Vasco, Zaragoza, Sevilla y Salamanca.

En los resultados destacan dos aspectos fundamentalmente, el alto grado de correlación existente entre los rankings y que en los rankings que consideran datos de investigación principalmente, hay 7 universidades por encima de la media. La situación empeora al considerar otros indicadores basados en encuestas y no exclusivamente relacionados con investigación, puesto que solamente la Autónoma de Barcelona está por encima de la media. Dicha universidad es la única que aparece por encima de la media en las dos dimensiones. Siempre hablando en términos comparativos con el resto de las universidades analizadas para esta solución de dos dimensiones, hay que añadir que muchas universidades que tienen un buen desempeño en investigación (Valencia, Granada, Sevilla y Zaragoza), lo tienen claramente menor en la segunda dimensión analizada.

Esperemos que dentro de pocos años, si se repite este estudio o se desarrolla otro similar, haya una décimoquinta universidad en el mismo y que sea la nuestra (más que un deseo debería de ser una obligación para nosotros).

Reconoce la justicia cognitiva, la necesidad de diversas comprensiones de la toma de conocimiento para coexistir en la producción científica.

Reconoce la justicia cognitiva, la necesidad de diversas comprensiones de la toma de conocimiento para coexistir en la producción científica.

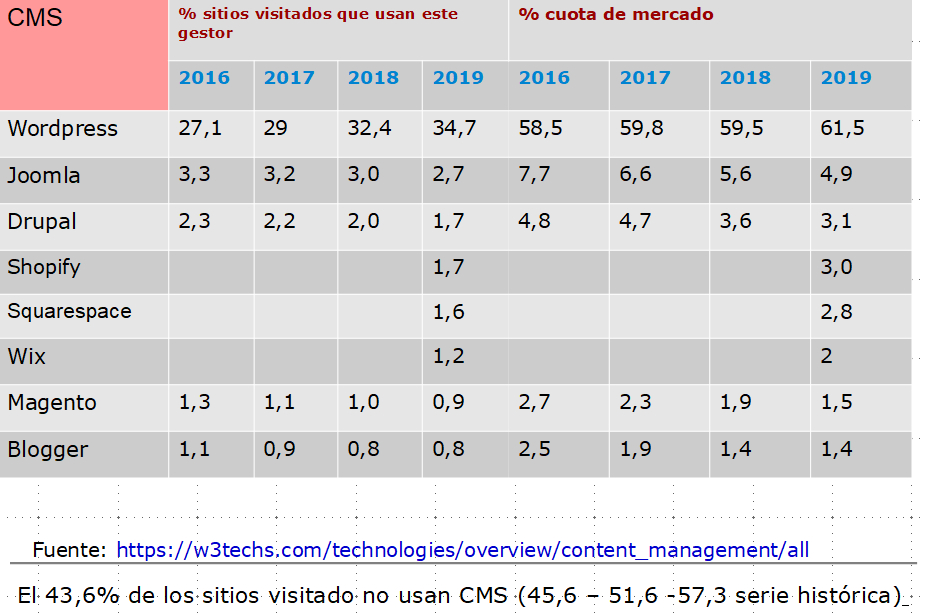

En 2019 publiqué la primera versión de este ‘post’ en el que recogía la tabla con datos estadísticos que les muestro curso a curso a mis estudiantes de la asignatura «Construcción de Servicios de Información Digital» (4º curso del

En 2019 publiqué la primera versión de este ‘post’ en el que recogía la tabla con datos estadísticos que les muestro curso a curso a mis estudiantes de la asignatura «Construcción de Servicios de Información Digital» (4º curso del