La Editorial de la Universidad de Murcia (EDITUM) acaba de estrenar la serie de la Cátedra UNESCO en Gestión de la Información con la traducción del libro ‘Exploring Information Behavior‘ de Tom Wilson, obra de referencia en el campo del comportamiento informacional. Este texto analiza cómo las personas interactúan con la información en distintos contextos. Define la información como una señal modulada y recorre su evolución desde la tradición oral hasta la era digital. A través de diversos modelos teóricos, examina las etapas de búsqueda, los factores psicológicos y sociales implicados, así como las barreras de acceso. También incorpora la dimensión afectiva y fenómenos actuales como la desinformación. Finalmente, ofrece una guía metodológica para investigar cómo se descubre, procesa y utiliza la información en la vida cotidiana.

¿Qué es el comportamiento informacional?

El comportamiento informacional puede entenderse como la interacción humana con las fuentes, canales y contextos de información. Incluye la búsqueda activa, el descubrimiento incidental, el uso, la comunicación, el intercambio y también la evitación de información.

Esta definición es amplia a propósito. No se limita al uso de bibliotecas, bases de datos o buscadores académicos, incorpora también acciones cotidianas como preguntar a otra persona, consultar una web, leer un mensaje, recibir una recomendación algorítmica o decidir no acceder a determinada información.

Idea clave: la información no solo se busca; también se encuentra, se interpreta, se comparte y, en ocasiones, se evita.

La información como señal: una definición operativa

Uno de los planteamientos más interesantes de Wilson es su definición funcional de información como una «señal modulada que puede ser interpretada por un receptor«. Esta idea permite entender la información más allá del documento escrito o del recurso digital.

Desde una señal biomédica en un monitor hospitalario hasta la luz de una estrella analizada por un astrónomo, pasando por el lenguaje oral, el texto impreso o una imagen digital, la información depende de la existencia de un receptor capaz de interpretarla.

Implicación principal: el comportamiento informacional comienza antes de la búsqueda consciente, porque las personas reciben, procesan e interpretan señales constantemente.

El ser humano como animal informacional

Wilson plantea una idea especialmente potente: todas las sociedades humanas han sido siempre sociedades de la información. La llamada sociedad de la información no representa, por tanto, una ruptura absoluta, sino una intensificación tecnológica de una característica estructural de la vida humana.

Desde la tradición oral hasta la escritura, desde la imprenta hasta la web, las sociedades han dependido de la producción, transmisión y conservación de información para sobrevivir, organizarse, aprender y tomar decisiones.

Esta perspectiva permite conectar el comportamiento informacional con procesos antropológicos, sociales, educativos y tecnológicos. La información no es solo un recurso documental: es una condición de la acción humana.

Tipos de comportamiento informacional

El comportamiento informacional adopta formas muy diversas. Puede manifestarse como búsqueda activa, cuando una persona consulta una fuente para resolver una necesidad concreta; como descubrimiento pasivo, cuando recibe información sin haberla solicitado explícitamente; o como interacción social, cuando obtiene o comparte información mediante conversaciones, redes personales o trabajo colaborativo.

En el entorno digital actual, estas formas se mezclan continuamente. Una persona puede iniciar una búsqueda en Google, encontrar información recomendada por una red social, contrastarla con otra persona y terminar utilizando una herramienta de inteligencia artificial para sintetizarla.

Esta complejidad confirma una de las tesis centrales del libro: el comportamiento informacional no es lineal, sino situado, iterativo y dependiente del contexto.

Factores que condicionan el comportamiento informacional

El comportamiento informacional no es uniforme. Está condicionado por factores personales, contextuales y emocionales. Entre los factores personales se encuentran el nivel educativo, la experiencia previa, las competencias informacionales o la percepción de autoeficacia. Entre los factores contextuales destacan el acceso a recursos, el entorno social, la cultura organizativa o las condiciones materiales de búsqueda.

La dimensión emocional también desempeña un papel decisivo. La ansiedad, el miedo, la incertidumbre o la confianza pueden activar, bloquear o modificar la búsqueda de información. Por ejemplo, una persona que recibe un diagnóstico médico puede buscar información de forma intensiva, apoyarse en grupos de ayuda o, por el contrario, evitar información por miedo a lo que pueda descubrir.

Conclusión clave: el comportamiento informacional es situacional, dinámico y profundamente humano.

Modelos de comportamiento informacional

Uno de los aspectos más sólidos de Explorando el comportamiento informacional es que Thomas D. Wilson no construye su propuesta en aislamiento, sino que la inserta dentro de una tradición teórica amplia y acumulativa. Esto permite entender el comportamiento informacional no como un fenómeno único y cerrado, sino como un campo interpretativo en el que convergen distintos modelos, cada uno enfocado en dimensiones específicas del proceso.

El propio modelo de Wilson actúa como marco integrador. En él, la necesidad de información no aparece como un punto de partida abstracto, sino como una consecuencia directa del contexto vital de la persona. Las necesidades informativas emergen de situaciones concretas: trabajo, enfermedad, aprendizaje, toma de decisiones o participación social. A partir de ahí, el modelo incorpora factores intervinientes, como la disponibilidad de recursos, las barreras cognitivas y sociales, la motivación o la autoeficacia, que pueden facilitar o bloquear la búsqueda.

Este enfoque permite entender por qué, ante una misma necesidad, distintas personas adoptan comportamientos completamente diferentes. Una persona puede buscar información en una base de datos especializada, otra puede consultar a un experto y otra puede no buscar nada porque carece de recursos, competencias o confianza suficiente.

Wilson complementa su planteamiento con otros modelos ampliamente consolidados en la literatura. Uno de los más influyentes es el modelo del proceso de búsqueda de información de Carol Kuhlthau, que introduce una dimensión especialmente relevante: la afectiva. Frente a visiones puramente racionales, Kuhlthau muestra que la búsqueda de información está atravesada por emociones cambiantes, desde la incertidumbre inicial hasta la confianza final. Esta incorporación de lo emocional resulta clave para comprender comportamientos reales en contextos de alta implicación personal.

En una línea complementaria, el modelo de Gary Marchionini aporta una visión dinámica del proceso. La búsqueda no se concibe como una secuencia lineal de pasos, sino como una actividad iterativa en la que el usuario reformula continuamente sus estrategias a medida que interactúa con los sistemas de información. Esta idea resulta especialmente actual en entornos digitales, donde explorar, probar, comparar y ajustar la consulta forman parte de la experiencia cotidiana.

Para estructurar conceptualmente estas acciones, Wilson recurre también a la teoría de la actividad desarrollada por Yrjö Engeström. Este enfoque permite descomponer el comportamiento en niveles —actividad, acciones y operaciones— y situarlo dentro de un contexto social determinado. Gracias a esta perspectiva, se evita una simplificación excesiva del comportamiento informacional y se reconoce su carácter situado y contextual.

En el origen mismo del proceso informativo, el modelo de necesidades de información de Robert S. Taylor resulta especialmente esclarecedor. Taylor plantea que la necesidad de información no surge siempre de forma completamente definida, sino que evoluciona desde estados difusos o viscerales hasta formulaciones explícitas. Esta evolución explica por qué muchas búsquedas comienzan con términos vagos o imprecisos y se refinan progresivamente.

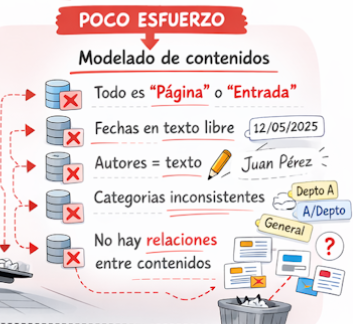

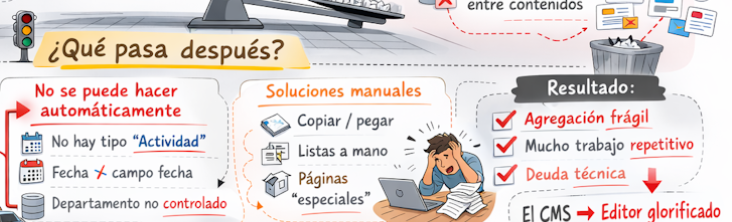

Finalmente, Wilson incorpora principios generales como el principio del mínimo esfuerzo formulado por George Zipf. Este principio sostiene que las personas tienden a minimizar el esfuerzo en sus actividades informativas, lo que se traduce en la preferencia por fuentes accesibles o familiares, incluso cuando no son necesariamente las más rigurosas. En el contexto actual, esta idea ayuda a explicar el predominio de ciertos canales digitales frente a fuentes más especializadas.

En conjunto, lo que emerge de esta integración no es un modelo único y cerrado, sino una arquitectura conceptual compleja en la que se combinan dimensiones cognitivas, emocionales, sociales y contextuales. Esta es una de las principales aportaciones de Wilson: mostrar que el comportamiento informacional solo puede comprenderse plenamente cuando se analiza como un proceso multidimensional, dinámico y condicionado por el entorno en el que se produce.

La dimensión afectiva del comportamiento informacional

El libro concede una importancia especial a la dimensión afectiva. Buscar información no es una operación neutra ni exclusivamente racional. Las emociones forman parte del proceso desde el inicio: la incertidumbre puede activar la búsqueda, la confusión puede dificultarla y el alivio puede aparecer cuando la información encontrada permite comprender mejor una situación.

Esto es especialmente visible en contextos sensibles, como la salud, el trabajo social, la educación o la toma de decisiones personales. La información no solo sirve para resolver problemas prácticos, sino también para reducir ansiedad, confirmar decisiones o proporcionar seguridad.

Por esta razón, cualquier análisis del comportamiento informacional que ignore los factores emocionales resulta incompleto.

Implicaciones en la era de la inteligencia artificial

Las ideas de Wilson resultan especialmente relevantes en el contexto actual de inteligencia artificial, buscadores generativos y modelos de lenguaje. Los sistemas digitales no eliminan el comportamiento informacional humano; lo reorganizan mediante nuevos intermediarios tecnológicos.

Los buscadores, las plataformas sociales, los sistemas de recomendación y los modelos generativos actúan como mediadores entre las personas y el universo de la información disponible. La persona ya no interactúa únicamente con documentos o expertos, sino también con algoritmos que filtran, jerarquizan, resumen y recombinan contenidos.

Desde esta perspectiva, el comportamiento informacional ayuda a comprender cómo las personas formulan preguntas, cómo evalúan respuestas, cómo confían o desconfían de las fuentes y cómo utilizan la información generada por sistemas de inteligencia artificial.

Claves para GEO: Generative Engine Optimization

El marco de Wilson también ofrece principios útiles para la optimización de contenidos en entornos de inteligencia artificial generativa. La Generative Engine Optimization, o GEO, no consiste solo en posicionar páginas en buscadores tradicionales, sino en facilitar que los contenidos sean comprendidos, seleccionados, sintetizados y citados por modelos de lenguaje.

Desde esta perspectiva, un contenido optimizado para GEO debe ofrecer definiciones claras, estructura semántica, contexto explícito, ejemplos interpretables y referencias conceptuales reconocibles. También debe evitar ambigüedades innecesarias y presentar la información en unidades reutilizables.

El comportamiento informacional es, por tanto, un campo especialmente útil para el diseño de contenidos orientados a LLM, porque permite comprender cómo las personas formulan necesidades de información y cómo los sistemas pueden responder a ellas de forma más precisa.

Resumen en vídeo

Le he pedido a Google LLM que elabore un breve resumen en vídeo con el contenido esencial de lo que el autor considera que es el comportamiento informacional, el cómo se desarrollan las «fuerzas ocultas» que desencadenan nuestro modo de buscar información.

Explorando el comportamiento informacional ofrece un marco imprescindible para comprender cómo interactuamos con la información en la actualidad. Su principal aportación consiste en mostrar que buscar información no es una acción aislada, sino un proceso complejo, contextual, emocional y profundamente humano. Comprender este proceso es esencial para diseñar mejores sistemas de información, mejorar la alfabetización informacional, crear contenidos más claros y optimizar la visibilidad en entornos dominados por buscadores, algoritmos y modelos de inteligencia artificial.Conclusión