Muchos compañeros míos docentes y profesionales gustan de escribir y opinar, cada vez que surge un nuevo tema de moda, que el mismo representa una gran oportunidad para «los profesionales de la Información y Documentación». Eso es algo recurrente (y lógico, tampoco vamos a criticarlo en exceso, forma parte de la forma de ser humana) que ha acaecido con los sistemas de gestión de la calidad, la usabilidad y el rediseño de webs, la inclusión de metadatos en los documentos publicados en la web y seguramente con muchas otras tecnologías y/o corrientes que ahora no recuerdo. Y mucho me temo que esto también va a pasar con todo lo relacionado con la Ley de Transparencia y Acceso a la Información Pública aprobada hace más o menos un año. En este punto, resulta curioso es que no proliferan, de momento, esos mensajes visionarios de nuevas oportunidades de empleo y riqueza. Algo es algo.

Pero lo cierto es que sí estamos ante un tema importante que debería ser de interés de nuestro sector profesional, en particular en la gestión de información. Esta ley (cuando se desarrolle de verdad y deje de ser palabrería barata conducente a maquillar a uno de los gobiernos más opacos y recovecos que hemos tenido en España), instrumentaliza el acceso a la información como (1) garantía de buen gobierno (o por lo menos, de gobierno «más transparente», lo que ha de conllevar el desarrollo de unos sistemas de información que permitan ese seguimiento de forma eficaz por parte de la ciudadanía, algo de lo que hoy no disfrutamos y (2) favorece la disposición para su reutilización posterior de ingentes cantidades de datos que obran en poder de las administraciones públicas y que pueden servir para generar alternativas de negocio en el sector de las TICs.

Si bien, como era de esperar por otra parte, en el primero de los ejes (el de los sistemas de información accesibles y transparentes) aun andamos en pañales (por no decir «estado embrionario»). Llama la atención que en nuestro país se hayan dado una serie de interesantes pasos en el camino de esa reutilización de información, situándonos a la cabeza a nivel europeo pero que, en este momento, no se hable de oportunidad para los gestores de información. No deja de ser una paradoja, pero es cierta.

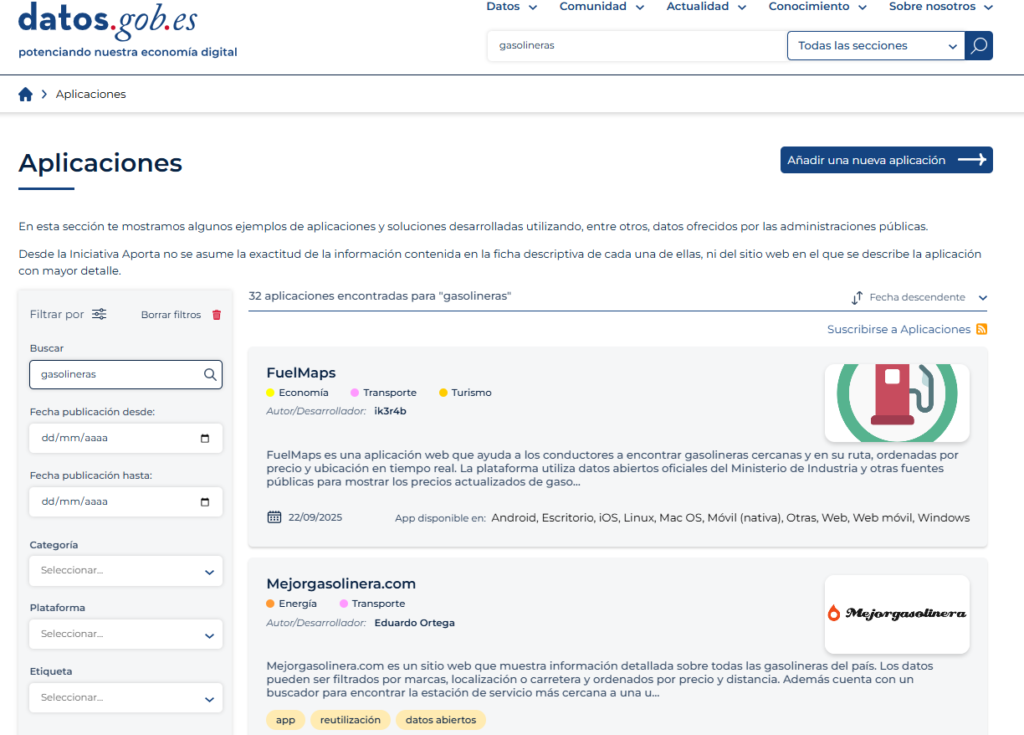

Este mismo mes hemos publicado un artículo sobre este tema, donde hemos analizado los conjuntos de datos abiertos disponibles en el portal datos.gob.es (lo más «transparente» que se había dispuesto en España antes de promulgar la ley) y el conjunto de aplicaciones web y móviles que se están desarrollando a partir de esos datos (búsqueda de gasolineras con sus precios y de bibliotecas).

Llama poderosamente la atención que en un entorno político tan corrompido como opaco que tenemos en nuestro país haya técnicos con esta mentalidad tan innovadora y abierta. En fin, así somos.